⚡ Pythonの処理を“爆速化”したいあなたへ

「ファイルを何個も読み込むだけで何十秒もかかる…」「APIを大量に叩く処理が遅すぎてつらい…」そんな経験はありませんか?Pythonのコードは基本的に上から順番に実行される逐次処理。前の処理が終わるまで次に進めない仕組みなので、待ち時間が積み重なるとあっという間に重たいプログラムになってしまいます。

そこで登場するのが並列処理(parallel)と並行処理(concurrent)。複数の処理を“同時”にこなせるようにすることで、これまで数十秒かかっていた処理が数秒に短縮できる——そんな世界が手に入ります✨ Python 3.2から登場したconcurrent.futuresモジュールを使えば、マルチスレッドもマルチプロセスもほぼ同じ書き方で実装できる手軽さも魅力です。

🧠 まずは“並列”と“並行”の違いをスッキリ整理

🚶 逐次処理:1人のワーカーが順番にこなす

普段書いているPythonコードは、1人の作業者が一つずつタスクをこなしているイメージ。テキスト1の読み込みが終わってからテキスト2の読み込みが始まるので、全ファイルの所要時間がそのまま合計されます。

👥 並列処理:複数のワーカーが同時に動く(CPUバウンド向け)

複数の作業者がそれぞれ別の作業を“本当に同時”に処理する方式です。大量の数値計算のようにCPUを酷使する処理(CPUバウンドな処理)に向いていて、Pythonではマルチプロセスで実現します。

🔀 並行処理:1人のワーカーが待ち時間を有効活用(I/Oバウンド向け)

1人の作業者が、ある処理の待ち時間に別の処理を挟み込むようにこなしていく方式。外から見ると同時に動いているように見えます。Web APIの呼び出しやディスクへの書き込みのように待ち時間が長い処理(I/Oバウンドな処理)に向いていて、Pythonではマルチスレッドで実現します。

💡 ざっくりまとめ:CPUゴリゴリ系は「マルチプロセス=並列」、待ち時間が多い系は「マルチスレッド=並行」。これだけ押さえれば、設計方針はかなりブレません。

🧰 concurrent.futuresの基本:たった数行で並行処理

Pythonにはmultiprocessingとthreadingという2つの標準モジュールがありますが、両方をまとめて扱えるのがconcurrent.futures。書き方がほぼ同じなので、後から「やっぱりマルチプロセスにしたい」と思っても切り替えがラクなのが嬉しいポイントです。

🧵 マルチスレッドで並行処理する基本形

from concurrent.futures import ThreadPoolExecutor

import time

def func1():

time.sleep(2)

print("func1-0")

time.sleep(2)

print("func1-1")

def func2():

time.sleep(1)

print("func2-0")

time.sleep(1)

print("func2-1")

def main():

with ThreadPoolExecutor(max_workers=2) as executor:

executor.submit(func1)

executor.submit(func2)

if __name__ == "__main__":

main()submit()を呼び出した瞬間に並行処理がスタート。出力結果はfunc1とfunc2のprintが入り混じった順序で表示され、ちゃんと同時に動いていることがわかります。

🎯 引数を渡したいとき・戻り値を取りたいとき

関数に引数を渡したい場合はsubmit(func2, x, y)のように、第2引数以降に値を並べるだけ。戻り値が欲しい場合はsubmit()の返り値(Futureオブジェクト)を変数に入れておき、.result()で取り出します。

with ThreadPoolExecutor(max_workers=2) as executor:

future1 = executor.submit(func1)

future2 = executor.submit(func2, "A", "B")

print(future1.result())

print(future2.result())🧮 max_workersの意味を正しく理解する

max_workersは同時に動く作業者の最大数です。たとえばmax_workers=2で3つの処理を投げると、最初に2つが同時に走り、どちらかが終わって作業者に空きが出てから3つ目が動き始めます。CPUコア数や処理特性に合わせて調整するのがコツです。

🗺️ map()でシンプルに一括並行処理

同じ関数を複数の引数で並行実行したいときはmap()がスマートです。

with ThreadPoolExecutor(max_workers=4) as executor:

results = executor.map(func1, ["A", "B", "C", "D"])

print(list(results))戻り値は実行順のジェネレータとして返ってくるので、list()で受け取ればOK。forループでsubmit()を4回書く方法より圧倒的に短くなります。

🚀 マルチプロセスへの切り替えはクラス名を変えるだけ

concurrent.futuresの真骨頂はここ。マルチスレッドからマルチプロセスへの変更は、ThreadPoolExecutorをProcessPoolExecutorに書き換えるだけで完了します。

from concurrent.futures import ProcessPoolExecutor

if __name__ == "__main__":

with ProcessPoolExecutor(max_workers=4) as executor:

results = executor.map(heavy_calc, range(100))

print(list(results))引数の渡し方も戻り値の受け取り方も、map()の使い方もすべて同じ。実行中にWindowsのタスクマネージャーやmacOSのアクティビティモニタを開くと、Pythonのプロセスが複数立ち上がっているのが目で見てわかるので、ぜひ手元で試してみてください👀

🛒 並列処理の学習を加速させる相棒アイテム

並列・並行処理は概念が抽象的なぶん、「実際に動かして体感する」ことが理解への一番の近道です。腰を据えて学べる環境を整えてあげると、スッと頭に入ってくる感覚が変わります。学習効率をぐっと底上げしてくれるアイテムを厳選して紹介します💪

📕 体系的に学ぶ定番書:『Python実践入門』

並行・並列処理を含む“一歩進んだPython”を、なぜそうなっているのかという背景込みで丁寧に解説してくれる名著。動画で得た知識を体系として固めるのに最適です。

📗 設計力まで一気に底上げ:『エキスパートPythonプログラミング』

マルチスレッド・マルチプロセス・非同期処理(asyncio)の使い分けや落とし穴まで踏み込んで解説。中級から上級へステップアップしたい人に刺さる一冊です。

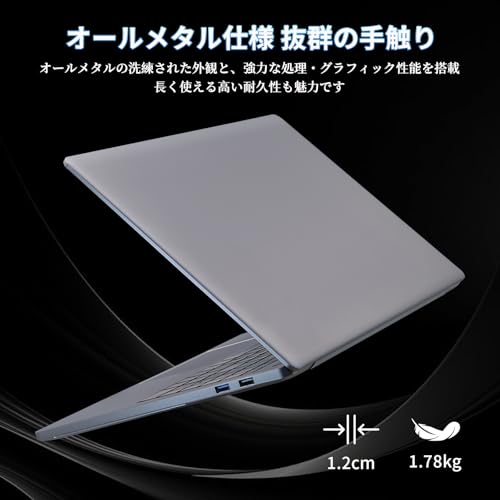

💻 並列処理を体感したいなら多コアCPUのノートPC

ProcessPoolExecutorの真価が出るのは、物理コアが多い環境。8コア以上のノートPCがあると、ベンチマークの差にビックリするはずです。学習用なら軽量・長時間バッテリーモデルが快適。

🖥️ ログとコードを並べて読むためのモバイルモニター

左でコードを書き、右でprintログやタスクマネージャーを眺める——並列処理の挙動把握は“2画面化”で劇的に楽になります。USB-C一本で接続できるモバイルモニターは在宅・カフェ問わず大活躍。

⌨️ 長時間コーディングを支える静音メカニカルキーボード

並行処理のデバッグは試行錯誤の連続。指への負担を減らしてくれる静音赤軸のメカニカルキーボードがあれば、集中時間が伸びてバグ解決スピードも上がります。

❓ よくある質問(FAQ)

🤔 Q1. マルチスレッドとマルチプロセス、迷ったらどちらを選べばいい?

処理の中身次第です。Web APIの呼び出しやファイルI/Oなど待ち時間が支配的な処理ならマルチスレッド、画像処理や数値計算などCPUを使い切る処理ならマルチプロセスがおすすめ。Pythonの場合、GIL(Global Interpreter Lock)の影響でCPUバウンドな処理はマルチスレッドにしてもあまり高速化しない点に注意です。

🙋 Q2. max_workersはどのくらいに設定すればいい?

I/Oバウンドな処理なら、コア数の数倍(例:os.cpu_count() * 5)でも有効に働きます。CPUバウンドな処理ならコア数前後が妥当です。設定を変えながら実測するのがいちばん確実なチューニング方法です。

🧐 Q3. submit()とmap()はどう使い分ける?

同じ関数を複数の引数で実行するならmap()がシンプル。引数や関数が処理ごとに異なる場合や、Futureオブジェクトを使って細かく制御したい場合はsubmit()が向いています。

🛡️ Q4. ProcessPoolExecutorを使うとき注意することは?

Windowsでは必ずif __name__ == "__main__":のブロック内で実行すること。プロセス生成時にスクリプトが再読込されるため、これを書かないと無限にプロセスが立ち上がってしまいます。また、引数や戻り値はpickleでシリアライズできるオブジェクトに限られる点にも注意です。

🌀 Q5. asyncio(非同期処理)とどう違うの?

asyncioは単一スレッド内でイベントループを使って待ち時間を有効活用する仕組みで、コルーチンベースの記述になります。concurrent.futuresはOSのスレッド/プロセスを使うので、既存の同期関数をほぼそのまま並行化できるのが強み。I/Oバウンドかつ大量同時接続ならasyncio、既存コードをサクッと並行化したいならconcurrent.futures、と覚えておくと選びやすいです。

🌟 まとめ:concurrent.futuresは“最初の一歩”に最適

Pythonの並列・並行処理は一見ハードルが高そうに見えますが、concurrent.futuresを使えばたった数行で処理速度を大幅に改善できます。ThreadPoolExecutorとProcessPoolExecutorを切り替えるだけでI/Oバウンド/CPUバウンドの両方に対応できる柔軟さは、知っているのと知らないのとで開発体験が大きく変わるレベル。

まずは小さなスクリプトでsubmit()とmap()を試して、タスクマネージャーでプロセスやスレッドが増える様子を眺めてみてください👀 そのうえで書籍やマシン環境への投資を組み合わせれば、学習スピードはさらに加速します。今日紹介したアイテムが、あなたのPythonライフを一段階レベルアップさせる相棒になりますように!

コメント