🎤 「会議のメモ取り」から解放される未来を手に入れる

会議や打ち合わせのたびに必死でメモを取り、終わった後に議事録を清書する。インタビュー音源を一時停止しながら何度も巻き戻して書き起こす。動画コンテンツの字幕を一文字ずつ入力する。こうした「耳で聞いて手で打つ」作業は、知らないうちに膨大な時間を奪っています。

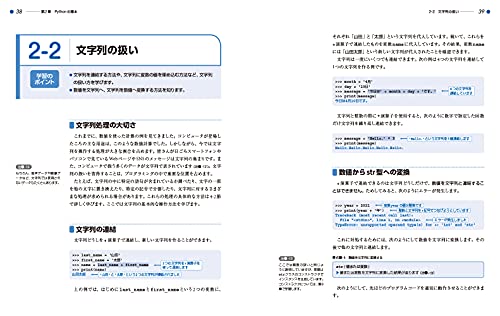

OpenAIが公開している音声認識AI「Whisper」をPythonから使えるようになると、この光景は一変します。会議を録音しておけば、後でPythonスクリプトに食わせるだけで、ほぼそのまま使える文字起こしが返ってきます。インターネット接続が不要なローカル実行なら、機密性の高い社内会議でもクラウドに音声を渡す心配はありません。今日から、自分の時間を「聞き取り作業」ではなく「考える仕事」に振り向け直せるようになります✨

📚 Whisperとは何か、何ができるのか

WhisperはOpenAIが公開している音声認識AIで、音声ファイルを入力するとその発話内容をテキストとして返してくれるモデルです。ChatGPTほどの知名度はないものの、日本語を含む多言語に対応しており、PythonからわずかなコードでローカルPC上でも動かせるという大きな魅力があります。

使い方は大きく分けて2つ。1つはOpenAIのWeb APIを叩く方法、もう1つはモデル本体をローカルにダウンロードして動かす方法です。ローカル実行のメリットは主に二つあって、まず利用料金がかからず無料で使えること。そしてモデルを一度ダウンロードしてしまえばオフライン環境でも動かせることです。社外秘の会議音声を扱うときや、長尺の音源を大量にバッチ処理したいときに、この特性は大きな武器になります🔒

🛠 ローカル環境で動かすための下準備

① ライブラリのインストール

まずはWhisper本体のPythonライブラリを入れます。ターミナルでpip install -U openai-whisperを実行するだけ。これでPythonコードからimport whisperと書けるようになります。

② FFmpegの導入

Whisperは内部で音声ファイルを扱うためにFFmpegを利用します。Macならbrew install ffmpeg、Ubuntuなどのlinuxならapt install ffmpeg、Windowsならパッケージマネージャーのchoco install ffmpegでインストールできます。Windowsで未導入の場合は、管理者権限でPowerShellを起動し、Chocolatey公式サイトに記載された一行コマンドを貼り付けて実行すればChocolatey自体もすぐに用意できます。

③ モデルの選択

Whisperにはtiny、base、small、medium、large、large-v2、large-v3と複数のモデルサイズが用意されています。大きいモデルほどファイルサイズも処理時間も増える代わりに、認識精度が高くなる傾向があります。すべてのモデルが日本語に対応しているので、まずは軽量なbaseで動作確認をしてから、必要に応じて大きいモデルへ切り替えていくのが堅実な進め方です。

💻 Pythonで音声をテキスト化する最小コード

準備が整ったら、Pythonスクリプトはとてもシンプルです。whisper.load_model("base")でモデルを読み込み、model.transcribe("test.wav")に音声ファイルのパスを渡すだけ。返ってくるのは辞書型のオブジェクトで、result["text"]に文字起こしされたテキスト、result["language"]に推定された言語コードが格納されています。

初回実行時はモデル本体のダウンロードが走るため、認識処理が始まるまで少し時間がかかります。2回目以降はローカルのキャッシュが使われるので、起動からテキスト出力までが一気に短くなります。試しに自分の声を録音した数十秒のwavファイルを食わせてみると、思った以上の精度に驚くはずです。多少の誤認識はあっても、議事録の下書きとして使うには十分すぎるレベルで返ってきます📄

⚡ GPUで処理を加速させる

長尺の音源や、より精度の高いlargeモデルを使いたい場合は、CPUだけだと処理に時間がかかります。そこで活躍するのがGPUです。torch.cuda.is_available()でGPUの利用可否を判定し、device="cuda"または"cpu"をload_modelの引数deviceに渡すだけで切り替えられます。

自宅にGPU搭載マシンがない場合は、Google CloudのVMインスタンスでDeep Learning VMイメージとNVIDIA T4 GPUを選んで起動すれば、ドライバ込みで一気に環境が整います。SSH鍵を登録してVS CodeのRemote SSH拡張からつなげば、ローカルと変わらない感覚でコードを書けます。実行中に別のターミナルでnvidia-smiを叩けば、GPUメモリがしっかり使われている様子が確認でき、処理時間が劇的に短くなったことを体感できるはずです🚀

🎁 文字起こし作業を加速させる相棒たち

Whisperの実力を最大限に引き出すには、入力となる音声の質と、開発を支える環境が大きくものを言います。きれいな音で録れていれば認識精度は素直に上がり、快適な作業環境があればコードを書く時間そのものが楽しくなります。文字起こしを日常業務に組み込んでいくなら、手元にそろえておきたいアイテムをいくつか紹介します。

🎙 高音質ICレコーダーで「録れていない」事故を防ぐ

会議やインタビューでありがちなのが、録れていたはずの音声がノイズだらけだったり、声が小さくて聞き取れなかったりするトラブル。専用のICレコーダーがあれば、雑音の少ないクリアな音で長時間録音でき、Whisperに渡したときの認識精度がぐっと上がります。打ち合わせメモから取材記事まで、用途を選ばず一台あると安心です。

🎧 オンライン会議の音をしっかり拾うUSBマイク

ZoomやTeamsの会議録音をWhisperで処理するなら、PCの内蔵マイクではなく単一指向性のコンデンサーマイクを用意したいところ。声をクリアに拾える定番USBマイクを一本机に置いておくだけで、自分の発話パートが正確にテキスト化され、議事録の品質が見違えます。

📘 PythonとAIライブラリを体系的に学べる入門書

Whisperを動かしながら「ここをもっとカスタマイズしたい」と思ったとき、Python本体の知識がしっかりしているかどうかで応用の幅が大きく変わります。文法から実用ライブラリまでを通しで学べる定番書を一冊やり込んでおくと、新しいAIモデルが登場しても即座に試せるようになります。

🖥 ノイズの少ない作業環境を作る静音キーボード

音声認識を試すうえで意外と重要なのが、自分の作業音が録音に混ざらないこと。打鍵音の小さいメカニカルキーボードや静電容量無接点キーボードを選んでおけば、録音中もタイピング音に邪魔されず、後からWhisperに食わせる音声がきれいに保てます。長時間のコーディング自体も快適になる、地味に効く一台です。

💾 大容量外付けSSDで音声・モデルファイルをまとめて保管

Whisperのlargeモデルは数GB単位のサイズになりますし、録音した音声データも積み重なれば一気に容量を圧迫します。NVMe接続の外付けSSDを一台用意しておくと、モデル・音声・書き起こしテキストを一括管理でき、別マシンへの環境移行もケーブル一本で完了します。

❓ FAQ|Whisperを使う前に気になるポイント

🤔 Q1. Whisperは本当に無料で使えるのですか?

ローカル実行であれば、モデルもライブラリもオープンソースとして公開されているため、追加の利用料金は発生しません。Web API経由で使う場合のみ、OpenAIの定めた従量課金が発生します。社内利用や個人プロジェクトで気兼ねなく試せるのは大きな魅力です。

🤔 Q2. どれくらいの精度で日本語を認識できますか?

baseモデルでも日常会話レベルなら十分実用的なテキストが得られますが、専門用語や固有名詞、滑舌の問題などで誤認識は出ます。精度を上げたい場合はmedium以上、特にlarge-v3を選ぶと体感できるほど改善されます。代わりに処理時間とマシン負荷は増えるので、用途とのバランスで選びましょう。

🤔 Q3. GPUがないPCでもlargeモデルは使えますか?

動かすこと自体は可能ですが、CPUだけだと長尺音源では現実的でないほど時間がかかることがあります。手元のマシンが非力な場合はクラウドGPUを時間貸しで借りる、あるいはbaseやsmallで運用するのが賢い選択です。

🤔 Q4. オフライン環境で社外秘の音声を扱っても安全ですか?

初回のモデルダウンロードさえ済ませてしまえば、その後はインターネット接続なしで動作します。音声データを外部に送信しないため、機密性の高い会議録の文字起こしにも適しています。ただし、社内の情報セキュリティポリシーは別途必ず確認してください。

🤔 Q5. 文字起こしの誤りを修正する効率的な方法は?

Whisperの出力をそのまま納品物にするのではなく、まずは下書きとして受け取り、固有名詞や専門用語をエディタの一括置換で整える運用が現実的です。タイムスタンプ付きで出力するオプションを使えば、修正したい箇所を音声で素早く確認でき、二度手間が大きく減ります。

🌟 まとめ|「聞いて書く」時間をAIに任せて、創造の時間を取り戻す

Whisperを使えるようになると、会議の議事録、インタビューの文字起こし、動画の字幕作成、語学学習用のディクテーションなど、これまで人手に頼ってきた作業が驚くほどシンプルなPythonスクリプトに置き換わります。load_modelとtranscribeのたった2行で動くシンプルさは、初めてAIに触れる人でも「自分の業務をAIで自動化できた」という成功体験を持ち帰れる稀有な題材です。

クリアな音を録るためのマイクやレコーダー、開発を支える書籍とハードウェア、そしてGPU活用のためのクラウド環境。これらを少しずつ整えながらWhisperを使い込んでいけば、半年後には「文字起こしは機械に任せ、自分は内容の解釈と意思決定に集中する」という新しい働き方が当たり前になっているはずです。今日インストールコマンドを一行打つところから、その未来は始まります🚀

コメント